深度学习相关知识

Confusion matrix混淆矩阵

混淆矩阵是 ROC 曲线绘制的基础,同时它也是衡量分类型模型 准确度中最基本、最直观、计算最简单的方法。以分类模型中的二分类为例,对于这 种问题,模型最终需要判断样本的结果是 0 还是 1,或者说是 Positive 还是 Negative。

因此,能得到这四个基础指标,可以看成是一级指标:

真实值是 Positive,模型认为 是 Positive 的数量(TP)。

真实值是 Positive,模型认为是 Negative 的数量(FN)。

真实值 是 Negative,模型认为是 Positive 的数量(FP)。

真实值是 Negative,模型认为是 Negative的数量(TN)。

将这四个指标一起呈现在表格中,就能得到如表 3 这样一个矩阵,称它 为混淆矩阵。预测性分类模型,是希望越准越好。在混淆矩阵中,TP 与 TN 的数量越 大越好,而 FP 与 FN 的数量越小越好。

accuracy rate:准确率

准确率指的是预测值为 1 且真实值也为 1 的样本在预测值为 1 的所有样本中所占 的比例。

recall rate:召回率

召回率指的是预测值为 1 且真实值也为 1 的样本在真实值为 1 的所有样本中 所占的比例。

AUC:

AUC 是指 ROC 曲线下与坐标轴围成的面积,这个面积的数值小于等于 1。又因 为 ROC 曲线一般都处于 y=x 这条直线的上方,所以 AUC 的取值范围在 0.5 和 1 之间。 AUC 越接近 1.0,检测方法的实性越高;等于 0.5 时真实性最低,无应用价值。

mAP :

是 Mean Average Precision 的缩写,即 均值平均精度。作为 object dection 中衡量检测精度的指标。计算公式为:

mAP = 所有类别的平均精度求和除以所有类别。

backbone: 主干网络

翻译为主干网络的意思,既然说是主干网络,就代表其是网络的一部分,那么是哪部分呢?翻译的很好,主干部分,哈哈哈哈,文字游戏了哈。这个主干网络大多时候指的是提取特征的网络,其作用就是提取图片中的信息,共后面的网络使用。这些网络经常使用的是resnet VGG等,而不是我们自己设计的网络,因为这些网络已经证明了在分类等问题上的特征提取能力是很强的。在用这些网络作为backbone的时候,都是直接加载官方已经训练好的模型参数,后面接着我们自己的网络。让网络的这两个部分同时进行训练,因为加载的backbone模型已经具有提取特征的能力了,在我们的训练过程中,会对他进行微调,使得其更适合于我们自己的任务。

head

head是获取网络输出内容的网络,利用之前提取的特征,head利用这些特征,做出预测。

neck

neck是放在backbone和head之间的,是为了更好的利用backbone提取的特征。

bottleneck

bottleneck:瓶颈的意思,通常指的是网网络输入的数据维度和输出的维度不同,输出的维度比输入的小了许多,就像脖子一样,变细了。经常设置的参数 bottle_num=256,指的是网络输出的数据的维度是256 ,可是输入进来的可能是1024维度的。

Embedding

通过将高维数据映射到较低维空间来解决稀疏输入数据的核心问题。

在深度学习实验中经常会遇Embedding层,然而网络上的介绍可谓是相当含糊。比如 Keras中文文档中对嵌入层 Embedding的介绍除了一句 “嵌入层将正整数(下标)转换为具有固定大小的向量”之外就不愿做过多的解释。那么我们为什么要使用嵌入层 Embedding呢? 主要有这两大原因:

使用One-hot 方法编码的向量会很高维也很稀疏。假设我们在做自然语言处理(NLP)中遇到了一个包含2000个词的字典,当时用One-hot编码时,每一个词会被一个包含2000个整数的向量来表示,其中1999个数字是0,要是我的字典再大一点的话这种方法的计算效率岂不是大打折扣?

训练神经网络的过程中,每个嵌入的向量都会得到更新。如果你看到了博客上面的图片你就会发现在多维空间中词与词之间有多少相似性,这使我们能可视化的了解词语之间的关系,不仅仅是词语,任何能通过嵌入层 Embedding 转换成向量的内容都可以这样做。

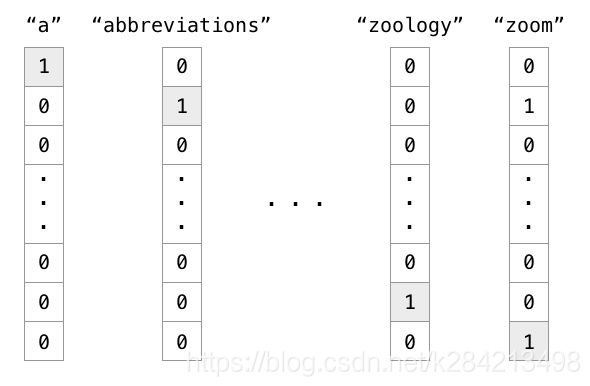

One hot representation独热编码

程序中编码单词的一个方法是one hot encoding。

实例:有1000个词汇量。排在第一个位置的代表英语中的冠词"a",那么这个"a"是用[1,0,0,0,0,…],只有第一个位置是1,其余位置都是0的1000维度的向量表示,如下图中的第一列所示。

GAP(Global Average Pooling)层

把 映射为

,满足了输入不同尺度的image的需求。你不管输入图片是

还是

,最后都给你映射为

。